管理人のイエイリです。

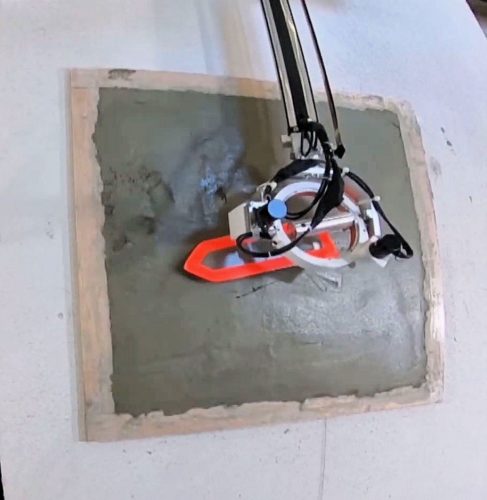

空調の効いた快適な室内で、モニター画面を見ながら、ハンドルを慎重に動かす職人さん。未来の工事では、こんな風景が当たり前になるかもしれません。

いったい、この職人さんは何をやっているのかというと、

ナ、ナ、ナ、ナント、

左官作業

だったのです。

別の場所では、職人さんの腕の動きに合わせて、コテを持ったアバターロボットが壁にモルタルを塗りつけて平らに仕上げる左官作業を行っていました。

つまり、職人さんの微妙な腕の動きと、アバターロボットの動きが連動するようになっているのです。

このシステムは、大林組と慶應義塾大学 グローバルリサーチインスティテュート ハプティクス研究センターの村上俊之センター長兼理工学部教授と野崎貴裕理工学部専任講師が共同で開発したものです。

職人さんの腕の動き(マスター側)をアバターロボット(スレーブ側)に伝えるために、「リアルハプティクス」という技術が使われました。

単に動きを伝えるだけでなく、実物のコテにかかる力触覚も、逆にアバターロボットから職人さんが持つハンドルへと伝わるようになっています。

ゲームのコントローラーに例えると、フォースフィードバック付きのハンドルというわけです。

大林組と実証実験では、職人さんが必要とする、細かい表面の仕上がり状況をカメラで撮影してモニター画面に表示し、力触覚を伝達するために厚さ1mm以下の精度でコテを動かせるようにしました。

その結果、コテによる微細な調整が可能になり、通常の左官作業と同等の仕上げ結果を再現できました。

今後の展開としては、

数百km離れた場所

間での遠隔左官作業に挑戦するそうです。

大林組と慶應義塾大学はこれまでも、リアルハプティクス技術を油圧ショベルに搭載し、バケットに作用する地盤の反力をオペレーターのハンドルに伝えるシステムを開発してきました。(詳細は、2018年10月16日付の当ブログ記事を参照)

この技術が実用化できれば、空調の効いた快適な室内にいながら、日本中や世界中の工事現場に“バーチャル出勤”して、左官作業など力加減が重要な作業もテレワークで行えるようになりそうですね。